株式会社シーエーシー(CAC)が提供する音声感情解析AI『Empath』は、音声から人間の喜怒哀楽や気分の浮き沈みを独自のアルゴリズムで判定するサービスだ。数万人の音声データベースを元にしており、コールセンターでのオペレーターのメンタルヘルス管理や1on1ミーティング用のマイクデバイス、3Dゲームキャラクターの表情生成支援など、様々な領域で活用されている。

今後、さらに普及していくであろう音声感情解析の分野において、『Empath』はどのような存在になり得るのだろうか。『Empath』の生みの親であり、CACの新規事業開発本部でEmpath事業統括を務める下地貴明に話を聞いた。

早稲田大学卒業後、コンテンツライティングやシステムエンジニアとしての経験を積み、その後、スマートメディカル株式会社で現在の『Empath』の技術を開発。2017年に株式会社Empathを設立し、2023年にCACに『Empath』事業を譲渡するとともに、自身も同社に籍を移した。

――これまでの経歴、音声感情解析AI『Empath』の研究・開発を行うことになったきっかけについてお聞かせください。

下地 大学はコンピューターサイエンスではなく、教育学部の国語国文学科という“ド文系”の出身です。そこで心理学を学んでいたことが、今の感情解析のサービス開発に役立ったと思っています。学生時代、ベンチャー企業でウェブサイトのコンテンツライティングをするアルバイトをしており、卒業後はその会社で引き続きアルバイトから正社員になって、そこでコンピューターサイエンスのスキルがほぼない状態から、必要に迫られてシステムエンジニアの仕事をするようになりました。

その後、1社を挟んで医療ヘルスケアの領域を扱うスマートメディカルという会社に入り、そこで『Empath』の技術を立ち上げることになりました。当時はフィジカルヘルスケアに関するITサービスは結構ありましたが、メンタルヘルスに関するものはほぼなく、社長に進言して技術調査をやらせてもらいました。

2012年頃から研究開発を始め、2014年に商用で販売を開始したのですが、非接触で感情が分かる技術は表情以外にあまりなかったので、目新しさもあって、いろいろな企業に興味を持っていただきました。そこからスピンオフして2017年に株式会社Empathを立ち上げ、6年間、代表を務めました。

――『Empath』の事業をCACに譲渡した背景を教えてください。

下地 『Empath』は私と山崎はずむさんという方の2人で立ち上げた会社です。山崎さんとはゴールデン街で知り合い(笑)、意気投合して創業しました。彼は『Empath』の中で『JamRoll』という、会議を録画してAIで感情解析をするSaaS型のサービスを立ち上げていまして、その開発自体は順調だったものの投資が先行しており、一方で音声感情解析への投資も必要だったため、資金獲得の方法を模索していました。

音声感情解析の技術自体は黒字化していたので、そこを引き受けてくれる先を2022年の夏ごろから探していたところ、元々、表情の感情解析を手掛けていたCAC Holdingsの執行役員の 池谷浩二さんとイベントでご一緒する機会がありました。そこで相談した際、CACも感情分野の領域を広げていきたいという想いがあり、また、我々のようなスタートアップの文脈が分かるチームをリクルートしたい考えもあったそうで、うまく話が進みました。

――『Empath』とはどのようなサービスなのでしょうか。

下地 人間の声から日本語の喜怒哀楽に近い喜び、平常、怒り、悲しみと、元気かどうかという五つの感情指標が解析できるプロダクトです。言葉の意味内容は考慮せず、発話が終わったタイミングで声のスピードやトーンから感情解析ができるエンジンになっています。

――どのような領域で活用されることが多いのでしょうか。

下地 当初、「コールセンターに向けたプロダクト」というニュースリリースを出したこともあり、コールセンターでの活用が多いですね。コールセンターではカスタマーからのクレームを受けることがあります。オペレーターはクレームを受け続けるとストレスが溜まり、欠勤や早期退職につながってしまいます。そうした際の対策として『Empath』を活用することで、オペレーターの健康管理やフォローがしやすくなり、離職率を下げることができます。

実際、コロナ禍の時にはコールセンターもリモート勤務に移行したところが多く、監督者(スーパーバイザー)はオペレーターのチェックがしにくい状態になったのですが、『Empath』を導入したことでオペレーターのメンタル状態が把握でき、フォローしやすくなったという声もいただいています。離職率がどれほど改善されたのかは、いろいろな要素が絡んでくるので測れない部分もありますが、あるコールセンターでは出勤率が9.4%ほど改善されたという結果が出ています。これは監督者とのコミュニケーションが円滑になり、相談しやすい環境になったことが影響しているそうです。

また、メンタルヘルスの領域はスマートメディカル社時代から取り組んでいまして、対話型のロボットAIプラットフォームの中に導入したり、1on1ミーティングを可視化するためにマイクデバイスの中に入れたりと、様々な分野でご活用いただいています。

クリックして詳細を確認する

――これまでの実績から、他業種や他業界から問い合わせなども入っているのでしょうか。

下地 やはりコールセンターからのお問い合わせが最も多いですね。我々の技術は音声がある程度、きれいな状態で取れていないと解析が難しいところがありますので、常にクリアな音声が取れるコールセンターは特に活用しやすいんです。

他には、今はどの企業もウェブ会議が主流になってきており、会議中の音声の解析、例えば1on1の会議でハラスメントのようなコミュニケーションになっていないかを確認したいといった相談を受けたりしています。

それと、ゲーム制作の現場において3Dキャラクターの自然な表情を作るのに、これまではデザイナーさんが細かい手作業でこなしていたものを、『Empath』に声優さんのデータを読み込ませ、どの感情が大きくなっているのかを0.3秒ごとに解析し、キャラクターの表情と自動的に連動させる技術を開発しました。これによって表情を作る作業時間を95%も削減することに成功しています。

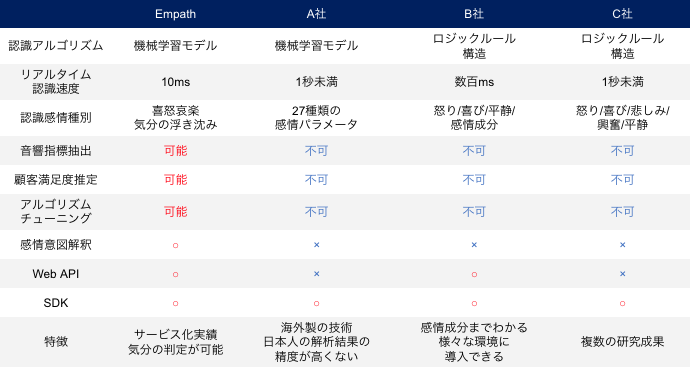

――音声感情解析AIに関連した技術を開発している企業は複数あると思います。競合他社と比較した際の『Empath』の強みを教えてください。

下地 似たような技術では海外の企業が開発しているものがあり、そちらはパラメーターの種類が多いのですが、海外の言語の学習データセットを使っているため、日本人の音声に対する解析の精度はそれほど高くありません。

また、日本国内でも音声感情解析AIの技術を提供している企業はありますが、大きな違いは、『Empath』はクラウド型のAPIで技術を提供しているところと、過去の実績と照らし合わせながら取得したデータをもとに感情の意図を解釈することができるところで、その技術の活用方法を各所に提案しています。

――今後、音声感情解析AIはどのような分野で普及していくとお考えでしょうか。

下地 ゲームの3Dキャラクターのケースのように、生成系のAIの裏側により入っていく可能性は間違いなくあると思います。現在、他社の著名なサービスではAIと自然対話ができるようになっていますが、文字面だけをとらえた対話になっており、感情が入った人間らしいコミュニケーションはまだまだできていません。

今後は音声UIがさらに普及していくと思いますので、我々の感情解析の技術をその裏側に入れていくことによって、よりユーザー体験を高められるような仕組みを作れると思っています。

また、『Empath』というサービスの名前は「empathy(共感)」という単語に由来しています。人間同士のコミュニケーションは感情が重要な役割を果たします。同じような交渉事でも、感情が先鋭化してしまうと衝突・決裂するということも起きますが、それを仲立ちするようなシステムを作ることができれば、もっと大きな市場が見えてくると思います。

――『Empath』をAI分野でどのような事業にし、どのような形で社会と関わり、貢献したいと考えていますか。

下地 『Empath』は2013年頃に、東日本大震災の復興支援をされているボランティアスタッフの方に使っていただいたのが最初なんです。被災地の方々は、言葉で「大丈夫」と言っていても実は大丈夫ではないというか、本当の自分の気持ちを伝えていただけないケースがありましたので、我々の技術で、無理をしていないかどうかを察知するために活用しました。

このように、コミュニケーションの中で起きる感情的な差異が、本来お互いが望んでいる方向からずれてしまう瞬間があると思います。そうした際に我々の技術を導入した音声ユーザーインタフェースを提供できれば、今のサービス以上にいろいろな形で人や組織をサポートできるはずです。そういった社会に貢献できる技術に成長させていきたいと考えています。

関連記事